Het vorige artikel in deze serie eindigde met de uitspraak dat veel wiskunde bestaat uit het bestuderen van verzamelingen met extra structuren, en van de functies tussen deze verzamelingen. Het eerste voorbeeld hiervan dat ik zal behandelen, en dat in de praktijk op talloze plekken wordt gebruikt, is lineaire algebra. In lineaire algebra worden vectorruimtes (de verzamelingen in kwestie) en matrices (de functies in kwestie) bestudeerd.

Vectorruimtes en matrices zijn in de wiskunde en voor allerlei toepassingen heel belangrijk. Het apparaat waar je dit artikel op leest is een goed voorbeeld: in feite bestaat de software die ervoor zorgt dat je dit artikel kan lezen namelijk uit een reeks aaneengeschakelde matrices. De hardware van je apparaat maakt het mogelijk om deze matrices snel samen te stellen. Dit idee van samenstellen zijn we in het vorige artikel al tegengekomen – het wordt voor matrices ook wel vermenigvuldiging genoemd. Ook large language models, zoals ChatGPT en Claude, bestaan uit matrixvermenigvuldigingen.

Zoals straks duidelijk zal worden aan de hand van voorbeelden, hebben vectorruimtes een bijbehorende dimensie. In de hierboven genoemde computertoepassingen is die dimensie vaak groot, maar niet oneindig.1 Plekken waar lineaire algebra voorkomt met vectorruimtes van een lagere dimensie zijn overigens ook niet moeilijk te vinden. Pak iets kleins bij je in de buurt vast in je hand, bijvoorbeeld een potlood, en draai het om zijn zwaartepunt rond. De rotatie van het potlood rondom dat zwaartepunt kan worden beschreven met een matrix die een driedimensionale vectorruimte afbeeldt op dezelfde driedimensionale vectorruimte. Op moment van schrijven zit ik in de trein, en draai ik mijn OV kaart rond in mijn hand. Waar de rotatie kan worden beschreven met behulp van een vectorruimte die gecentreerd is rond het zwaartepunt van de kaart, kan de locatie van het zwaartepunt van de OV kaart zelf, ten opzichte van een bepaald vast gekozen punt (bijvoorbeeld Amsterdam Centraal Station), ook weer beschreven worden met een vector, in een andere driedimensionale vectorruimte.

Ook in de quantummechanica is lineaire algebra onmisbaar. Een golffunctie – de wiskundige beschrijving van de toestand van een quantummechanisch systeem – is namelijk niets anders dan een vector in een vectorruimte. Zo wordt de spin van een elektron beschreven door een tweedimensionale vector, en is de golffunctie van een deeltje in de ruimte een vector in een oneindigdimensionale vectorruimte. De tweedimensionale spin heeft overigens veel te maken met rotatie (diezelfde rotatie als van de OV kaart), maar dat is een ander verhaal.[2]

Het moge duidelijk zijn dat lineaire algebra een belangrijk onderdeel vormt van de wiskunde. Niet voor niets is lineaire algebra voor veel technische opleidingen aan de universiteit een van de eerste vakken die studenten moeten volgen. Zelfs op de middelbare school vormen vectorruimtes tegenwoordig een deel van het lesprogramma.

Vectorruimtes

De voorbeelden hierboven hebben nog niet duidelijk gemaakt wat een vectorruimte wiskundig voorstelt. Laten we daar dus nu naar kijken.

Een verzameling \( V \) is een vectorruimte zodra de volgende twee operaties kunnen worden uitgevoerd: (1) Elke twee elementen \( v,w\in V \) kunnen worden opgeteld, en hun som \( v+w \) is ook een element in \( V \). Dit heet optelling van vectoren. (2) Elk element \( v\in V \) kan worden vermenigvuldigd met een getal \( c\in\mathbb{R} \) (of als we met complexe getallen willen werken: \( c\in\mathbb{C} \)), en het product \( cv \) is ook een element in \( V \). Dit heet scalaire vermenigvuldiging.

De optelling en scalaire vermenigvuldiging moeten voldoen aan acht verdere (natuurlijke) eigenschappen, die in feite zeggen dat de optelling in de vectorruimte een optelling is die je gewend bent, en vermenigvuldiging een vermenigvuldiging die je gewend bent. Twee van die voor de hand liggende eigenschappen zijn bijvoorbeeld \( (v+w)+u=v+(w+u) \) en \( 1v=v \). Belangrijke eigenschappen zijn ook dat er een nulvector \( 0\in V \) moet zijn, waarvoor \( 0+v=v \) voor alle \( v\in V \), en dat er voor elke vector \( v\in V \) een ‘tegengestelde’ vector \( -v\in V \) is zodat \( v+(-v)=0 \).

Als het getal \( c \) waarmee vermenigvuldigd kan worden reëel is, dan heet \( V \) een reële vectorruimte. Als \( c \) complex kan zijn, dan heet \( V \) een complexe vectorruimte.

Een voorbeeld van een (reële, driedimensionale) vectorruimte wordt aangeduid met \( \mathbb{R}^3 \). Als verzameling bevat \( \mathbb{R}^3 \)de elementen (of, de vectoren) \( (x,y,z) \) met \( x,y,z\in\mathbb{R} \) drie reële getallen. Soms, zoals we zo direct zullen zien als we matrices beschouwen, is het handig om zo’n element weer te geven als

\( \begin{bmatrix} x \\ y \\ z \end{bmatrix}, \)

wat een kolomvector wordt genoemd. We kunnen zulke vectoren inderdaad bij elkaar optellen: de optelling van \( (x_1,y_1,z_1) \) en \( (x_2,y_2,z_2) \) levert namelijk \( (x_1,y_1,z_1)+(x_2,y_2,z_2)=(x_1+x_2,y_1+y_2,z_1+z_2)\in\mathbb{R}^3 \) op. Ook kunnen we vermenigvuldigen met een reëel getal \( c\in\mathbb{R} \). Dan krijgen we \( c(x,y,z)=(cx,cy,cz)\in\mathbb{R}^3 \). De nulvector is uiteraard de vector \( (0,0,0)\in\mathbb{R}^3 \).

Op precies dezelfde manier vormt \( \mathbb{C}^3 \) een vectorruimte, en dit is dan een complexe driedimensionale vectorruimte. We kunnen deze voorbeelden natuurlijk generaliseren naar \( \mathbb{R}^n \) en \( \mathbb{C}^n \) met \( n\in\mathbb{N}_0 \) een natuurlijk getal. In het bijzonder vormt voor \( n=1 \) de ruimte \( \mathbb{R}^1=\mathbb{R} \) een vectorruimte, oftewel: de reële getallen zelf vormen ook een vectorruimte.

De hierboven genoemde voorbeelden (inclusief het wat flauwe voorbeeld van alleen het getal 0, wat we kunnen zien als het geval \( n=0 \)) zijn meteen álle eindigdimensionale reële en complexe vectorruimtes, zoals we straks met iets meer kennis zullen zien. De voorbeelden kunnen nog wel in verschillende verschijningen tevoorschijn komen. Een ander belangrijk voorbeeld van een vectorruimte is namelijk als volgt: laat \( A \) een willekeurige verzameling zijn, en definieer de ruimte van functies op \( A \) als

\( \mathcal{F}(A)=\{ f:A\rightarrow \mathbb{R}\}. \)

Deze ruimte van functies is zelf óók een vectorruimte. We kunnen functies namelijk bij elkaar optellen en vermenigvuldigen met een getal, en ook aan alle andere eisen blijkt voldaan te zijn. De dimensie van deze vectorruimte is precies het aantal elementen van \( A \), en kan dus eindig maar ook oneindig zijn.

Voor de echte liefhebbers noem ik nog wat voorbeelden. Afhankelijk van eventuele extra structuur die \( A \) heeft, kunnen we meer eisen van de functies. Zo kunnen we voor bepaalde verzamelingen \( A \), zoals \( A = \mathbb{R} \), eisen dat de functies continu zijn (wat ongeveer betekent dat als we de functie tekenen, we onze pen niet op hoeven te tillen van het papier – denk aan de functie \( f(x)=x^3 \) die ik beschreef in het vorige artikel in deze serie). Zulke continue functies vormen ook een vectorruimte, die bevat is in de vectorruimte van álle functies op \( A \). Ook kunnen we bijvoorbeeld eisen dat de functies allemaal 0 zijn in een vast punt \( a\in\mathbb{A} \). Het is een leuke opdracht om na te gaan dat functies van zo’n soort bij elkaar inderdaad een vectorruimte vormen.

Dimensie

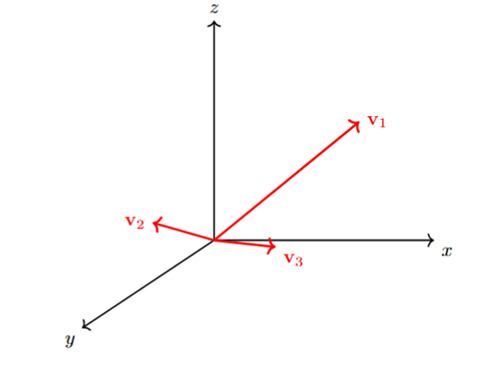

Ik heb het gehad over de dimensie van een vectorruimte, maar nog niet uitgelegd wat dat precies betekent. We kunnen dit het beste begrijpen aan de hand van het eerste voorbeeld van een vectorruimte, \( \mathbb{R}^3 \). Merk namelijk op dat we een vector \( (x,y,z)\in\mathbb{R}^3 \) kunnen schrijven als som van drie ‘elementaire’ vectoren \( (1,0,0), (0,1,0), (0,0,1) \) vermenigvuldigd met getallen, dat wil zeggen: als \( (x,y,z)=x(1,0,0)+y(0,1,0)+z(0,0,1) \). Wiskundigen zeggen dat de drie elementaire vectoren de vectorruimte \( \mathbb{R}^3 \) voortbrengen of opspannen. Er wordt wel geschreven

\( \mathbb{R}^3=\mbox{span}\{(1,0,0),(0,1,0),(0,0,1)\} \)

Deze elementaire vectoren zelf kunnen we niet in elkaar uitdrukken: we kunnen bijvoorbeeld op geen manier \( (1,0,0) \) uitdrukken als som van \( (0,1,0) \) en \( (0,0,1) \) met bepaalde vermenigvuldigingsfactoren. De drie vectoren noemen we lineair onafhankelijk, en het feit dat geen van de drie in termen van de twee andere kan worden geschreven is equivalent aan het feit dat de vergelijking \( \lambda (1,0,0)+\mu (0,1,0)+\nu(0,0,1) =0 \) maar één oplossing heeft, namelijk \( \lambda=\mu=\nu=0\).

Een verzameling vectoren in een vectorruimte \( V \) die de vectorruimte voortbrengt en die lineair onafhankelijk is, heet een basis voor de vectorruimte. Voor \( \mathbb{R}^3 \) vormt \( \{(1,0,0), (0,1,0), (0,0,1)\} \) dus een basis, die de standaardbasis heet. Zo’n basis is verre van uniek: ook bijvoorbeeld de vectoren \( \{(1,1,0), (1,-1,0), (0,0,1) \) vormen een basis. (Overtuig jezelf daar vooral van!) Wel kan, met niet al te veel moeite, worden aangetoond dat twee verschillende bases voor een vectorruimte \( V \) altijd hetzelfde aantal vectoren bevatten. Dit aantal heet de dimensie van \( V \). Om die reden zei ik dat \( \mathbb{R}^3 \) een vectorruimte van dimensie 3 is!

Deelruimtes

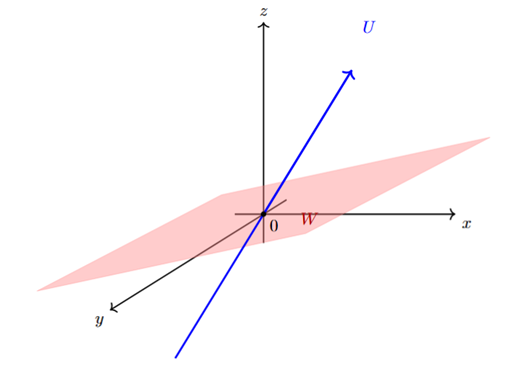

Voor verzamelingen zagen we het concept van deelverzamelingen: verzamelingen die bevat zijn in een grotere verzameling. Zo’n zelfde constructie bestaat voor vectorruimtes, waarbij we niet alleen op zoek zijn naar een willekeurige deelverzameling van de oorspronkelijke vectorruimte – je wilt ook dat die deelverzameling zelf ook weer een vectorruimte is. Als je twee vectoren in de deelverzameling optelt wil je bijvoorbeeld dat het resultaat ook in de deelverzameling zit. Zo’n deelverzameling wordt een deelruimte genoemd. Omdat zo’n deelruimte zelf een vectorruimte is, heeft ze een basis, en die basis is natuurlijk ook bevat in de grotere vectorruimte. Een voorbeeld van een deelruimte is de ruimte

\( W=\mbox{span}\{(1,0,1), (0,1,-1) \}\subset \mathbb{R}^3. \)

Dit is een deelruimte van \( \mathbb{R}^3 \) van dimensie twee, opgespannen door de vectoren \( (1,0,1) \) en \( (0,1,-1) \). De deelruimte bevat daarmee (check zelf!) alle vectoren \( (a,b,a-b) \) voor \( a,b\in\mathbb{R} \). Omdat een vectorruimte per definitie de oorsprong \( 0 \) moet bevatten, gaan alle deelruimtes door het punt \( 0 \). Zo zien we dat mogelijke deelruimtes van \( \mathbb{R}^3 \) in vier types voorkomen:

- Deelruimtes van dimensie nul. Dat is er maar eentje, namelijk alleen de vectorruimte die alleen het punt \( (0,0,0) \) bevat.

- Deelruimtes van dimensie één. Dat zijn precies alle lijnen door de oorsprong.

- Deelruimtes van dimensie twee. Dat zijn alle vlakken door de oorsprong; een voorbeeld is de ruimte \( W \) die hierboven is gedefinieerd.

- Deelruimtes van dimensie drie. Ook dat is er maar eentje, namelijk \( \mathbb{R}^3 \) zelf.

We kunnen een ander voorbeeld construeren in termen van functies. Laat \( A \) een verzameling zijn en kies een punt \( a\in A \). Schrijf

\( \mathcal{F}_a(A)=\{f:A\rightarrow \mathbb{R} \mid f(a)=0\} \).

Oftewel: \( \mathcal{F}_a(A) \) bevat alle functies die nul zijn in het punt \( a \). Dan is \( \mathcal{F}_a(A) \subset \mathcal{F}(A) \) een deelruimte van de vectorruimte die alle functies op \( A \) bevat.

Matrices

Voor functies tussen verzamelingen waren er eigenlijk geen eisen. Voor functies tussen vectorruimtes willen we het liefste wel iets eisen, namelijk dat de functie de vectorruimte-structuur behoudt. Dat wil zeggen: als \( V \) en \( W \) (bijvoorbeeld reële) vectorruimtes zijn, dan zijn we geïnteresseerd in functies \( M\colon V\rightarrow W \) waarvoor geldt dat, voor alle vectoren \( v,w\in V \) en voor alle \( c\in\mathbb{R} \),

\( M(v+w)=M(v)+M(w) \text{ en } M(cv)=cM(v). \)

Zo’n functie heet een lineaire afbeelding, of, in het geval dat \( V \) en \( W \) allebei eindigdimensionaal zijn, een matrix. Waarschijnlijk heb je het woord ‘matrix’ wel eens gehoord als beschrijving van een ‘tabel met getallen’, en dat blijkt ook precies te zijn waar we het hier over hebben! De algemene vorm van een matrix zoals ik die hierboven heb omschreven is namelijk mooi weer te geven. Laten we hiervoor als voorbeeld \( V=\mathbb{R}^3 \) en \( W=\mathbb{R}^2 \) nemen. Dan werkt \( M \) op een vector \( (x,y,z)\in\mathbb{R}^3 \), en krijgen we als resultaat een vector in \( M((x,y,z))\in\mathbb{R}^2 \). Uit de twee eigenschappen waar \( M \) aan moet voldoen, volgt dat deze uitkomstvector de volgende vorm moet hebben:

\( M((x,y,z))=(m_1x+m_2y+m_3z, m_4x+m_5y+m_6z), \)

Met \( m_1,\ldots ,m_6\in\mathbb{R} \). Dit wordt weergegeven als

\( M((x,y,z))=\begin{bmatrix} m_1 & m_2 & m_3 \\ m_4 & m_5 & m_6 \end{bmatrix} \begin{bmatrix} x \\ y \\ z \end{bmatrix}. \)

De matrix \( M \) is dus de ‘tabel’ met de getallen \( m_1 \) tot en met \( m_6 \). Hier is ook de vermenigvuldiging te zien waar ik eerder in dit artikel al over sprak. In feite is de werking van de afbeelding \( M \) op de vector \( (x,y,z) \) namelijk de vermenigvuldiging van de matrix \( M \) met deze vector, waarbij de vermenigvuldiging werkt door elke rij in de matrix stapsgewijs te vermenigvuldigen met de vector, en de uitkomsten van deze vermenigvuldigingen bij elkaar op te tellen.

De samenstelling van lineaire afbeeldingen \( M_1\colon V\rightarrow W \) en \( M_2\colon W\rightarrow U \) is op te schrijven in termen van matrices als \( (M_2\circ M_1)(v) =M_2M_1 v \). In deze weergave is duidelijk waarom zo’n samenstelling matrixvermenigvuldiging heet. Omdat de samenstelling als “tussenstap” dezelfde vectorruimte \( W \) moet hebben (het bereik van \( M_1 \) en het domein van \( M_2 \)), volgt dat twee matrices alleen vermenigvuldigd kunnen worden als de linker matrix evenveel kolommen heeft als het aantal rijen van de rechter matrix.

De matrix die het resultaat van de matrixvermenigvuldiging \( M_2M_1 \) voorstelt, kan worden uitgedrukt in termen van de getallen in de matrices \( M_2 \) en \( M_1 \) afzonderlijk. Stel bijvoorbeeld dat we \( V=\mathbb{R}^3 \) en \( W=U=\mathbb{R}^2 \) hebben, met \( M_1 \) zoals hierboven (met de getallen \( m_1,\ldots ,m_6 \)), en met

\( M_2 = \begin{bmatrix} n_1 & n_2 \\ n_3 & n_4 \end{bmatrix}. \)

Lukt het je dan om een uitdrukking voor \( M_2M_1 \) als één matrix te vinden (met drie kolommen en twee rijen)? Je kan het antwoord vinden door \( M_2M_1((x,y,z)) \) uit te rekenen, door eerst met \( M_1 \) te werken en daarna met \( M_2 \). Als extra puzzel kan je vervolgens de gevonden formule toepassen op bijvoorbeeld de matrices

\( M_1=\begin{bmatrix} 1 & 0 & 3 \\ 2 & 1 & 0 \end{bmatrix}, \qquad M_2 = \begin{bmatrix} 1 & 2 \\ 1 & -1 \end{bmatrix}. \)

Als je het antwoord hebt gevonden, of het antwoord hebt opgezocht onderaan dit artikel, zie je dat matrixvermenigvuldiging alleen bestaat uit het vermenigvuldigen en optellen van getallen. Dit soort operaties zijn precies wat een computer heel goed doet. Daarom bestaat software uit het vermenigvuldigen van matrices, en zorgt de hardware ervoor dat de computer dit zo snel mogelijk doet.

Injectief, surjectief, bijectief

Voor functies heb ik in het vorige artikel de eigenschappen van injectief, surjectief en bijectief zijn benoemd. Ook matrices kunnen die eigenschappen hebben; matrices zijn ten slotte functies. Een matrix \( M\colon V\rightarrow W \) is injectief als voor elke twee (verschillende) vectoren \( v,w\in V \) geldt dat \( M(v)\neq M(w) \). Met behulp van lineariteit kunnen we dit omschrijven naar \( M(v-w)\neq 0 \). Als \( v \) en \( w \) verschillend zijn, is \( v-w\neq 0 \). Injectiviteit kan dus alternatief worden beschreven als \( M(u)\neq 0 \) voor alle \( u\in V\setminus \{0\} \).

De deelverzameling van alle vectoren die door een matrix op 0 worden afgebeeld, heet de kern van de matrix. Dat wordt opgeschreven als

\( \mbox{ker}(M)=\{v\in V\mid M(v)=0 \}. \)

De kern is niet alleen een deelverzameling maar zelf ook weer een vectorruimte (overtuig jezelf daarvan!) en dus een deelruimte van \( V \), en een matrix is dus injectief als de kern alleen de nulvector bevat, oftewel: nuldimensionaal is. Als \( V \) een hogere dimensie heeft dan \( W \), kan een matrix \( M\colon V\rightarrow W \) nooit injectief zijn. De kern van die matrix is in dat geval een deelruimte van dimensie ten minste één.

De matrix \( M\colon V\rightarrow W \) is surjectief als elke vector in \( W \) van de matrix wordt bereikt. Een matrix kan nooit surjectief zijn als de dimensie van \( V \) kleiner is dan die van \( W \). Als de dimensie van \( V \) ten minste even groot is als die van \( W \), kan met behulp van het zogenoemde matrixvegen worden nagegaan of de matrix surjectief is. Ik zal dit matrixvegen niet in veel detail uitleggen in dit artikel, maar waar het op neer komt is het zover mogelijk reduceren van de matrix tot een matrix met alleen getallen op en boven de diagonaal heeft (een bovendriehoeksmatrix), door verschillende rijen in de matrix bij elkaar op te tellen en van elkaar af te halen. Heef het resultaat op de diagonaal alleen getallen die niet nul zijn, dan is de oorspronkelijke matrix surjectief. Door in de matrix \( M_2 \) van hierboven bijvoorbeeld de eerste rij één keer van de tweede rij af te trekken, krijgen we de bovendriehoeksmatrix

\( \begin{bmatrix} 1 & 2 \\ 0 & -3 \end{bmatrix}. \)

Omdat alle getallen op de diagonaal ongelijk aan nul zijn, is deze matrix dus surjectief.

Een matrix is bijectief als hij zowel injectief als surjectief is. Dit is, gezien de observaties van hierboven, alleen mogelijk als de dimensie van \( V \) gelijk is aan de dimensie van \( W \). Oftewel: \( M \) moet een vierkante matrix zijn. Maar let op: niet elke vierkante matrix is bijectief. Ook een vierkante matrix hoeft namelijk niet injectief (of surjectief) te zijn. De nulmatrix, gevuld met alleen maar nullen, is bijvoorbeeld niet bijectief – probeer ook dat weer zelf in te zien. Als \( M \) wél bijectief is, heeft de functie een inverse. Die inverse blijkt opnieuw een lineaire afbeelding te zijn en is dus een matrix, die wordt genoteerd als \( M^{-1} \). De inverse voldoet aan \( MM^{-1}=M^{-1}M=\mathbb{1} \), waar \( \mathbb{1} \) de identiteitsmatrix is: een vierkante matrix met enen op de diagonaal, en nul op alle andere plekken. De identiteitsmatrix heeft (uiteraard) de eigenschap dat \( \mathbb{1}(v)=v \) voor alle \( v\in V \), en beschrijft dus de identiteitsfunctie op \( V \).

Een manier om inverteerbare matrices tussen vectorruimtes \( V \) en \( W \) te construeren, is door een matrix te definiëren die een basis van \( V \) precies afbeeldt op een basis van \( W \). Als dit mogelijk is, kunnen we \( V \) identificeren met \( W \), en zijn ze daardoor eigenlijk één en dezelfde vectorruimte. Dit is precies waarom ik eerder in dit artikel zei dat \( \mathbb{R}^n \) en \( \mathbb{C}^n \) voor \( n\in\mathbb{N}_0 \) samen álle eindigdimensionale vectorruimtes vormen.

Een voorbeeld van een inverteerbare matrix is de matrix \( M_2\colon\mathbb{R}^2\rightarrow\mathbb{R}^2 \) van eerder. De inverse van deze matrix is

\( M_2^{-1}=-\frac{1}{3}\begin{bmatrix} -1 & -2 \\ -1 & 1 \end{bmatrix} \).

Je kan voor jezelf nagaan dat \( M_2M_2^{-1}=M_2^{-1}M_2=\begin{bmatrix} 1 & 0 \\ 0 & 1 \end{bmatrix}. \)

Er bestaat een recept om de inverse van een willekeurige matrix uit te rekenen, die ook weer te maken heeft met het matrixvegen wat ik eerder benoemde. Dit recept zal ik niet in dit artikel uitleggen.3

Eigenwaardes en eigenvectoren

Voor matrices \( M\colon V\rightarrow V \) die als domein en bereik dezelfde vectorruimte hebben, kan je je afvragen of er vectoren \( v \) zijn waarvoor geldt dat \( Mv\in \mbox{span}\{v\} \). Oftewel: zijn er vectoren zijn die door \( M \) op een veelvoud van zichzelf worden afgebeeld? Het flauwe geval \( v = 0 \) tellen we daarbij niet mee. Als zo’n vector bestaat, heet dat een eigenvector. Met andere woorden: \( v \) is een eigenvector als er een \( \lambda\in \mathbb{R} \) is zodat \( Mv=\lambda v\). Het getal \( \lambda \) heet de eigenwaarde horend bij de eigenvector \( v \).

Voor de identiteitsmatrix is élke vector een eigenvector, met bijbehorende eigenwaarde 1. Immers, \( \mathbb{1}v=v \) voor elke \( v\in V \). Het algemene recept om van de matrix \( M \) zijn eigenwaardes en eigenvectoren uit te rekenen, komt neer op het vinden van de nulpunten van een polynoom (het karakteristiek polynoom), en het uitrekenen van de kern van de matrix \( M-\lambda\mathbb{1} \), waar \( \lambda \) zo’n nulpunt is. De nulpunten van het polynoom zijn namelijk precies de eigenwaardes, en de vectoren in de kern zijn precies de bijbehorende eigenvectoren. Voor de matrix \( M_2 \) kan je met die methode nagaan dat zijn eigenwaardes \( \sqrt{3} \) en \( -\sqrt{3} \) zijn, met respectievelijk de bijbehorende eigenvectoren

\( v_1=\begin{bmatrix} 1+\sqrt{3} \\ 1 \end{bmatrix},\qquad \text{en } v_2=\begin{bmatrix} 1-\sqrt{3} \\ 1 \end{bmatrix}. \)

Inderdaad kun je narekenen dat \( M_2v_1=\sqrt{3}v_1 \) terwijl \( M_2v_2=-\sqrt{3}v_2 \).

In het geval waar we met complexe getallen werken, heeft een vierkante matrix die werkt op een vectorruimte \( V \) van dimensie \( n \) altijd precies \( n \) (niet per sé verschillende) eigenwaardes. Het kan echter voorkomen dat hij minder eigenvectoren heeft dan eigenwaardes. Dit kan alleen gebeuren als tenminste één van de eigenwaardes van de matrix meer dan eens voorkomt. Een voorbeeld is de matrix \( \begin{bmatrix} 1 & 2 \\ 0 & 1 \end{bmatrix} \). Die heeft twee keer de eigenwaarde 1, maar slechts één eigenvector, namelijk de vector \( (1,0) \). (Strikt genomen is elke veelvoud van \( v \) ook een eigenvector, maar de ruimte van eigenvectoren is ééndimensionaal).

Ruimtes van matrices

Wat voor representatietheorie, het onderwerp waar we nog altijd naar op weg zijn, erg belangrijk is, zijn bepaalde veel voorkomende ruimtes van matrices. Deze zijn in de wiskunde zelfs zo belangrijk, dat ze hun eigen naam hebben gekregen. Aan het begin van dit artikel had ik het al over het draaien van een object rondom zijn zwaartepunt, met als voorbeeld mijn OV-chipkaart. Het zwaartepunt van mijn OV-chipkaart kan ik als het punt \( (0,0,0) \) definiëren in een driedimensionale vectorruimte \( \mathbb{R}^3 \): de ruimte waarin we ons kunnen bewegen. De rotatie van de OV-chipkaart wordt dan beschreven door een matrix, en de verzameling van alle mogelijke rotatiematrices wordt aangeduid met de abstracte naam \( SO(3) \). Wat ikzelf niet met mijn OV-chipkaart kan doen, maar wat je je waarschijnlijk wel kan voorstellen, is de OV-chipkaart spiegelen. Er is geen combinatie van rotaties die ik kan doen om die spiegeling voor elkaar te krijgen, maar ook de spiegeling wordt beschreven met behulp van een matrix. De ruimte van matrices die zowel spiegelingen als rotaties bevat wordt aangeduid met de naam \( O(3) \). Op dezelfde manier bevatten de ruimtes \( SO(n) \) en \( O(n) \) de matrices van rotaties en rotaties+spiegelingen van \( \mathbb{R}^n \). Nog een voorbeeld: de verzameling van alle inverteerbare matrices op \( \mathbb{R}^n \) wordt opgeschreven als \( GL(n) \). In het volgende artikel zullen we zien dat al deze verzamelingen van matrices extra structuur hebben, het zijn namelijk groepen.

Ten slotte – we zijn immers uiteindelijk geïnteresseerd in de natuurkunde – nog enkele woorden over quantummechanica. Ik heb al gezegd dat golffuncties zelf vectoren zijn. De bekende Schrödingervergelijking waaraan die golffuncties moeten voldoen, luidt

\( i\hbar \frac{d}{dt} \psi(x,t)=\hat{H}\psi(x,t). \)

Hier is \( \psi(x,t) \) de golffunctie van het deeltje dat je beschrijft. Als functie van zowel de plaats als de tijd is \( \psi \) een vector in een (oneindigdimensionale) vectorruimte. Van deze vectorruimte vraag je vaak nog wat extra structuur, en die noem je dan een hilbertruimte. Op deze extra structuur kom ik later in deze serie nog terug. Alvast als vooruitblik: als we bijvoorbeeld een deeltje in \( \mathbb{R}^4 \) willen beschrijven (drie ruimtelijke dimensies en de tijd-dimensie), dan wordt de hilbertruimte genoteerd als \( L^2(\mathbb{R}^4) \), en is de golffunctie een vector \( \psi\in L^2(\mathbb{R}^4) \). In de quantummechanica is naast de golffunctie ook de \( H \) die in de Schrödingervergelijking voorkomt belangrijk voor het systeem dat je wilt beschrijven. \( H \) heet de Hamiltoniaan van het systeem, en zegt iets over de energie in het systeem. Wat blijkt nu: eigenlijk is de Hamiltoniaan ‘gewoon’ een matrix die werkt op een oneindigdimensionale vectorruimte. Natuurkundigen zijn vaak geïnteresseerd in golffuncties met een bepaalde constante energie, vanwege de wet van behoud van energie. Een golffunctie met constante energie \( E \) moet voldoen aan \( H\psi=E\psi \). Oftewel: zo’n golffunctie is een eigenvector van de Hamiltoniaan! Ook hierop zal ik nog uitgebreid terugkomen in een later deel van deze serie, maar eerst staan in het volgende deel groepen op het programma.

Antwoorden op de vragen:

- De functies op een verzameling \( A \) die 0 zijn op \( a\in A \) vormen een vectorruimte, omdat we voor zulke functies \( f \) en \( g \), en voor \( c\in\mathbb{R} \), vinden dat \( (f+g)(a)=f(a)+g(a)=0 \) en \( (cf)(a)=cf(a)=0 \) – \( f+g\) en \( c f \) zitten dus inderdaad óók in de deelverzameling \( A \). Ook voldoet de functie die overal nul is aan \( 0(a)=0 \), en is dus ook een element van \( A \) – en daarmee is aan alle eisen voldaan.

- De algemene uitdrukking voor matrixvermenigvuldiging is

\( \begin{bmatrix} n_1 & n_2 \\ n_3 & n_4 \end{bmatrix}\begin{bmatrix} m_1 & m_2 & m_3 \\ m_4 & m_5 & m_6 \end{bmatrix} = \begin{bmatrix} n_1m_1+n_2 m_4 & n_1m_2+n_2m_5 & n_1m_3+n_2m_6 \\ n_3m_1+n_4m_4 & n_3m_2+n_4m_5 & n_3m_3+n_4m_6 \end{bmatrix}. \)

Voor het voorbeeld vinden we dus

\( \begin{bmatrix} 1 & 2 \\ 1 & -1 \end{bmatrix}\begin{bmatrix} 1 & 0 & 3 \\ 2 & 1 & 0 \end{bmatrix}=\begin{bmatrix} 5 & 2 & 3 \\ -1 & -1 & 3 \end{bmatrix}. \)

[1] Later in dit artikel zullen we zien dat vectorruimtes ook oneindig-dimensionaal kunnen zijn, en zullen we zo’n vectorruimte tegenkomen.

[2] Zie bijvoorbeeld dit Wikipedia-artikel. Later in deze serie zal ik waarschijnlijk nog nader ingaan op dit concept.

[3] Mocht je geïnteresseerd zijn: deze website geeft een goede uitleg van het recept.